更新2026.4.9版本后,好像又报错了。

Something went wrong while processing your request. Please try again, or use /new to start a fresh session.

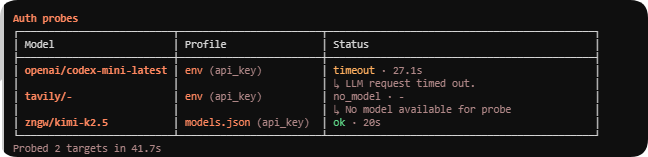

使用openclaw status未报任何错误,然后,看了New-API查看OpenClaw未调用模型API,回到上龙虾查询了一下模型情况openclaw models status --probe,结果发现有个莫名其妙的openai/codex-mini-latest报超时

问题分析

openai/codex-mini-latest模型是什么呢?

openai/codex-mini-latest 是 OpenAI 官方的一个模型别名(alias),它是基于 o4-mini(或类似基础模型)微调的 快速推理模型,专门优化用于 Codex CLI(OpenAI 的代码/代理相关工具链)。

为什么没有配置会出现在这里?

OpenClaw(尤其是 2026.4.9 这个新版本)在 models status --probe 时会自动扫描/探测所有内置的常见模型(包括 openai/ 前缀下的各种 gpt/codex 变体),不只是你自己在 models.json 或环境变量里显式配置过的。

- 它把 openai/codex-mini-latest 当作一个“候选模型”加入了 Auth probes 列表。

- 但你没有给它提供有效的 OpenAI API key(或对应的 openai-codex OAuth),所以 probe 请求直接超时(timeout · 27.1s)。

- 旁边那个 tavily/- 的 “no_model” 是正常的(Tavily 是搜索工具 provider,没模型可探)。

更新到 2026.4.9 后,这个内置模型列表可能被扩展或 probe 逻辑更激进,导致以前没问题的环境突然多出一个超时项,进而触发全局的 “Something went wrong while processing your request” 错误,导致发消息给小龙虾报错。

怎么解决呢?

看描述,openai/codex-mini-latest使用了env的api_key,查看配置的.env文件,发现配置的模型Key使用了环境变量OPENAI_API_KEY,结果OpenClaw内部可能就用了这个变量,发现我配置了这个Key,就调用了openai/codex-mini-latest,然后发现访问不了openai的地址,就报超时,触发了全局错误。

解决办法就是,换一个变量名,自己用的模型Key把遍历名改一下,如:环境变量配置 MODELS_API_KEY,openclaw.json中配置:

"models": {

"mode": "merge",

"providers": {

"zngw": {

"baseUrl": "https://New-API域名/v1",

"apiKey": "$MODELS_API_KEY",

"api": "openai-completions",

"models": [

// 模型名配置

]

}

}

// 其他配置

}

测试

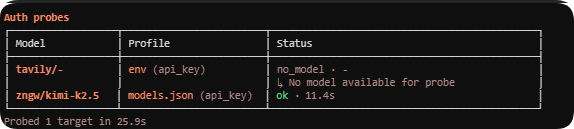

重启,再次使用openclaw models status --probe测试就没有这个内置模型报错了

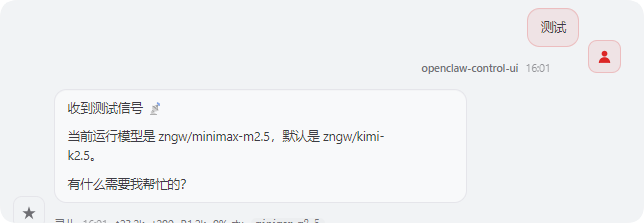

再回到小龙虾里测试

评论区