用 AI 助手最烦的事,就是它突然失忆

有没有遇到过这样的问题,让它改一个项目,它自己在改,你去做了个饭吃完回来,它改好了,你高高兴兴的让他提交SVN(自己的项目喜欢用SVN做版本管理),结果他问你SVN认证失败。明明让它永久记住账号密码了,结果一次又一次的给你忘记。

这真不是它故意气你。传统 RAG 就是把聊天记录切成碎片,再靠向量相似度去捞,捞着捞着就丢了因果、断了时间线,上下文一长直接抓瞎。

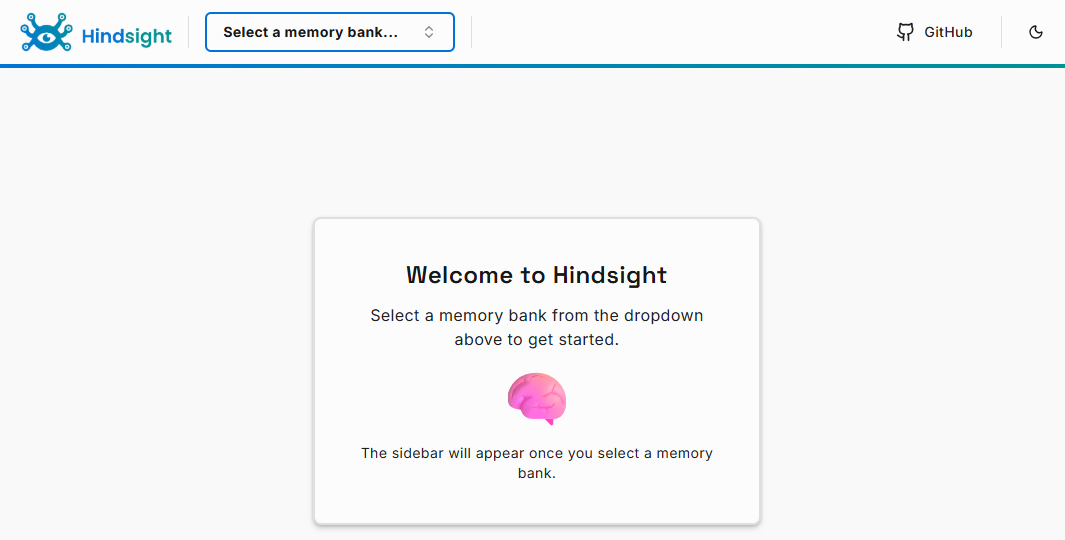

用了大半个月的 Hindsight 后,我觉得终于能好好跟 AI 聊天了。

Hindsight 是什么?

Hindsight 是 Vectorize 推出的开源 Agent 记忆系统,核心目标是让 AI 代理(Agent)真正学会并长期记忆,而不仅仅是“记住对话历史”。

- 在 LongMemEval 长程记忆基准上达到 91.4% 准确率(使用 Gemini 3 Pro 时),由 Virginia Tech 和《华盛顿邮报》参与验证,是当前 SOTA 之一。

- 也在 BEAM 等超长上下文(百万到千万 token)基准上领先。

- 开源(MIT 协议),支持本地部署和云服务。

技术架构(人类记忆式设计)

它把记忆分成四个逻辑网络(或称三层结构,表述略有差异):

- **World(世界事实)**:客观、外部的硬知识,不依赖个人经历。

- **Experiences / Observations(经历 / 观察)**:带时间戳的具体事件和代理自身的经历。

- **Mental Models / Opinions(心理模型 / 观点)**:从经历中提炼出的规律、信念和总结,会随新证据更新。

支持 **retain(存)、recall(取)**、reflect(反思) 三个核心操作。

检索方式是四路并行:语义检索 + 关键词 + 图关系 + 时间线,确保在长上下文和复杂推理场景下表现更好。

安装超级简单

本地使用 Docker 部署:

-

- 使用本地 嵌入/重排序 模型,大语言模型使用官方OpenAI

docker run -d --name hindsight --restart unless-stopped \

-p 8888:8888 -p 9999:9999 \

-e HINDSIGHT_API_LLM_API_KEY='你的API Key' \

-v ~/.hindsight-docker:/home/hindsight/.pg0 \

ghcr.io/vectorize-io/hindsight:latest

-

- 使用本地 嵌入/重排 模型,大语言模型使用自定义OpenAI兼容模型

docker run -d --name hindsight --restart unless-stopped \

-p 8888:8888 -p 9999:9999 \

-e HINDSIGHT_API_LLM_PROVIDER=openai \

-e HINDSIGHT_API_LLM_API_KEY='你的API Key' \

-e HINDSIGHT_API_LLM_BASE_URL='自定义大语言模型接口地址' \

-e HINDSIGHT_API_LLM_MODEL='模型ID' \

-v ~/.hindsight-docker:/home/hindsight/.pg0 \

ghcr.io/vectorize-io/hindsight:latest

-

- 嵌入、重排、大语言模型 都使用自定义的

docker run -d --name hindsight --restart unless-stopped \

-p 8888:8888 -p 9999:9999 \

-e HINDSIGHT_API_LLM_PROVIDER=openai \

-e HINDSIGHT_API_LLM_API_KEY='你的大语言模型API Key' \

-e HINDSIGHT_API_LLM_BASE_URL='自定义大语言模型接口地址' \

-e HINDSIGHT_API_LLM_MODEL='大语言模型ID' \

-e HINDSIGHT_API_EMBEDDINGS_PROVIDER=openai \

-e HINDSIGHT_API_EMBEDDINGS_OPENAI_MODEL='嵌入模型ID(如:bge-m3)' \

-e HINDSIGHT_API_EMBEDDINGS_OPENAI_API_KEY='嵌入模型API Key' \

-e HINDSIGHT_API_EMBEDDINGS_OPENAI_BASE_URL='嵌入模型地址' \

-e HINDSIGHT_API_RERANKER_PROVIDER=siliconflow \

-e HINDSIGHT_API_RERANKER_SILICONFLOW_MODEL='重排序模型ID(如:bge-reranker-v2-m3)' \

-e HINDSIGHT_API_RERANKER_SILICONFLOW_BASE_URL='重排序模型地址' \

-e HINDSIGHT_API_RERANKER_SILICONFLOW_API_KEY='重排序模型API key' \

-v ~/.hindsight-docker:/home/hindsight/.pg0 \

ghcr.io/vectorize-io/hindsight:latest

启动后,API 在 http://localhost:8888,管理界面在 http://localhost:9999。

注:如果要用外部PostgreSQL

# 删除这行

-v ~/.hindsight-docker:/home/hindsight/.pg0 \

# 修改为

-e HINDSIGHT_POSTGRES_URL='postgresql://user:password@ip:5432/hindsight' \

AI Agent集成

-

- OpenClaw 集成

安装插件:

openclaw plugins install @vectorize-io/hindsight-openclaw

配置:

{

"plugins": {

"entries": {

"hindsight-openclaw": {

"enabled": true,

"config": {

"hindsightApiUrl": "http://ip:8888",

"bankId": "openclaw",

"dynamicBankId": false # 这个配置共用同一bank id

}

}

}

}

}

-

- Hermes 集成

hermes 默认集成,只要配置memory重启就可以了。

- Hermes 集成

memory:

provider: hindsight

mode: local_external

api_url: http://localhost:8888

bank_id: hermes

auto_recall: true

auto_retain: true

memory_mode: hybrid

实际用下来什么感觉?

装好之后,至少SVN帐号密码从来没忘记过了哈。

还有其他的几个我最常用的场景:

日常助手 切换会话不再害怕,它会自动去 Hindsight 里查。“接着上次那个xxx项目继续”——它立刻就能接上进度。

技术调研 以前新开一个会话就要重新讲背景,现在它自己记得之前分析过的技术、踩过的坑、最终结论,直接接着往下聊。

插件里几个值得注意的细节

- Session Pattern 过滤:不是所有内容都往记忆里塞。它会自动过滤系统日志和工具输出,只保留有价值的部分。

- Retain Queue 机制:记忆不是一条一条存,而是批量处理后打包提交,节省资源。

- 多 Bank 隔离:支持多个独立的记忆库,切换 Bank ID 就能隔离不同场景或用户。

- 版本兼容:0.5.0+ 新增 update_mode: 'append',老版本会 fallback 到不同 document id,避免覆盖历史记忆。

最后

Hindsight 解决的不是“AI 记不住”,而是“AI 记了也不会用”的问题。

三层记忆结构、四路并行检索、强时序和因果能力,这才像一个靠谱的长程记忆系统。

如果你每天用 AI 超过半小时,强烈建议试试。两条命令就能跑起来,效果自己上手就知道。

评论区