一个寒假,养了只小龙虾(OpenClaw)断断续续体验了一些时间,结果发现Token消耗上亿了,对于休闲玩玩,不想发大资金的来说,找免费的API是白嫖关键。下面推荐几个用的还行的免费Token。

1. 阿里千问Coding Plan

这个不免费,但也算白菜价,7.9元一杯密雪冰城的价格,使用qwen3.5-plus超适合OpenClaw日常使用。

- 活动截至时间:2026年3月31日

- 活动页面:https://www.aliyun.com/benefit/ai/aistar?userCode=bc0o1jx7

- 速度:普通请求 5 秒内有响应,复杂的会延迟

- 限制:只限请求次数,不限Token量。

- 每5小时1,200 次请求

- 每周9,000 次请求

- 每月18,000 次请求

- 协议与BaseURL:

- OpenAI 兼容协议:

https://coding.dashscope.aliyuncs.com/v1 - Anthropic 兼容协议:

https://coding.dashscope.aliyuncs.com/apps/anthropic

- OpenAI 兼容协议:

- 推荐模型:qwen3.5-plus(支持图片理解)、kimi-k2.5(支持图片理解)、glm-5、MiniMax-M2.5;

- 更多模型:qwen3-max-2026-01-23、qwen3-coder-next、qwen3-coder-plus、glm-4.7

2. NVIDIA

老黄还是挺良心的,完全免费,可能使用人数过多,随机不稳定。

- 官方主页:https://build.nvidia.com/

- 速度:运气好 3~5秒有响应,运气不好 几分钟也很正常,非热门模型响应速度快。

- 限制:40rpm (每分钟40次)

- 协议与BaseURL:

- OpenAI 兼容协议:

https://integrate.api.nvidia.com/v1

- OpenAI 兼容协议:

- 推荐模型:minimaxai/minimax-m2.5、deepseek-ai/deepseek-v3.2、z-ai/glm5、z-ai/glm4.7、qwen/qwen3.5-397b-a17b、moonshotai/kimi-k2.5

- 更多模型:https://build.nvidia.com/models

3. Modal.com

Modal.com 是一个高性能的云基础设施平台(Serverless Cloud Platform),提供模型API不是主业务,不过有glm-5模型免费用

- 截至时间:2026年4月(现在可用,后面能不能免费待定)

- 官方主页:https://modal.com/glm-5-endpoint

- 速度:一般5秒内收到响应,复杂计算可能需要几分钟

- 限制:单并发,使用了 FP8 量化,精度可能略有下降

-

- 协议与BaseURL:

- OpenAI 兼容协议:

https://api.us-west-2.modal.direct/v1

- 可用模型:zai-org/GLM-5-FP8

4. 阿里魔搭

也是阿里系的,需要绑定阿里百炼账号。

- 官方主页:https://www.modelscope.cn/models

- 速度:普通请求 10 秒内有响应,复杂的会延迟

- 限制:只限请求次数,不限Token量。

- 每天限制 2,000 次请求

- 单模型每天 500 次请求

- 协议与BaseURL:

- OpenAI 兼容协议:

https://api-inference.modelscope.cn/v1

- OpenAI 兼容协议:

- 推荐模型:Qwen/Qwen3.5-397B-A17B、deepseek-ai/DeepSeek-V3.2、moonshotai/Kimi-K2.5、MiniMax/MiniMax-M2.5、ZhipuAI/GLM-5;

- 更多模型:https://www.modelscope.cn/models

5. 心流AI

这里阿里旗下的产品(iflow.cn),主打编程,但也有正常模型

- 官方主页:https://platform.iflow.cn

- 速度:普通请求 10 秒内有响应,复杂的会延迟

- 限制:暂时不明

- 协议与BaseURL:

- OpenAI 兼容协议:

https://api-inference.modelscope.cn/v1

- OpenAI 兼容协议:

- 推荐模型:qwen3-coder-plus、qwen3-max、kimi-k2、deepseek-v3.2;

- 更多模型:https://platform.iflow.cn/models

6. 智谱AI

智谱新用户有送2000万免费Token,分到几个模型上了,对于OpenClaw来说压根不够用,不过,他提供了一个简单免费的模型

- 官方主页:https://open.bigmodel.cn

- 速度:普通请求 10 秒内有响应,复杂的会延迟

- 限制:单并发

- 协议与BaseURL:

- OpenAI 兼容协议:

https://open.bigmodel.cn/api/paas/v4/

- OpenAI 兼容协议:

- 推荐模型:glm-4.7-flash;

总结

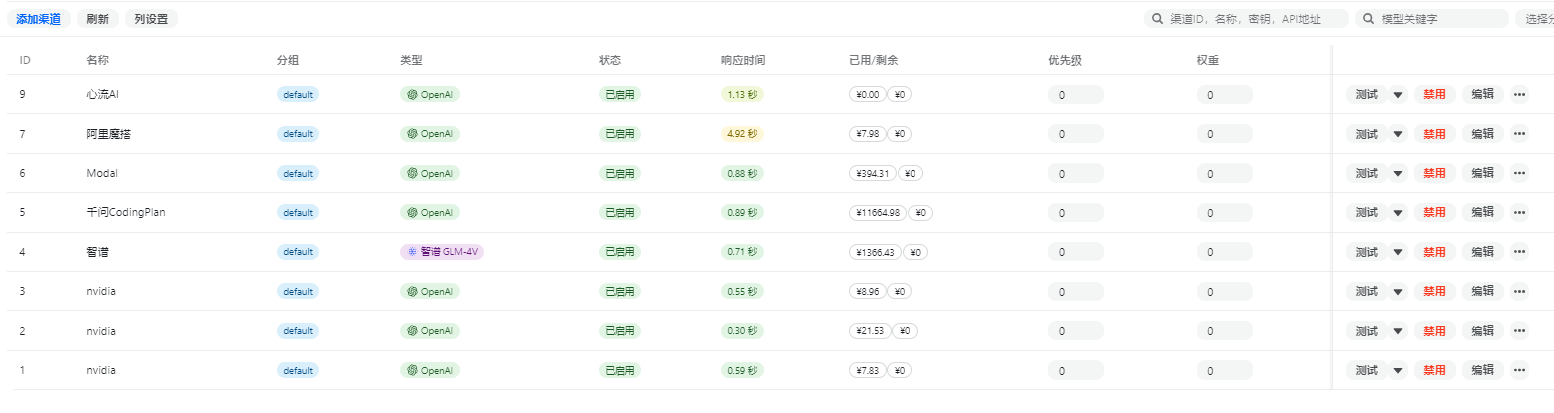

有了这么多免费的API,直接添加到 New-API中,然后根据速度和使用量设置一个权重,开始轮寻,给OpenClaw使用,基本够用了哈。

评论区