国内各大厂的CodingPlan计划都在收紧涨价,免费的API,国内免费几千万额度还不够OpenClaw几分钟折腾的,国外一些无限额度存在超时不稳定情况,于是想本地搭建一个试试。

一、为什么本地部署?

简单来说就三个理由:

- 数据不出内网 :所有对话、文件、知识库都在本地,不用担心隐私泄露

- 零 API 成本 :模型跑在自己机器上,随便用不花钱

- 离线可用 :没网也能用,适合对数据敏感的场景

当然,代价是你得有自己的硬件,并且模型能力取决于你买的显卡。

二、硬件配置与模型选择

硬件门槛

| 配置等级 | GPU | 显存 | 内存 | 可运行模型 |

|---|---|---|---|---|

| 入门 | 无 (仅 CPU) | - | 16GB+ | Qwen3.5-0.8B/2B |

| 推荐 | RTX 3060/4060 | 12GB | 32GB | Qwen3.5-4B/9B |

| 高端 | RTX 3090/4090 | 24GB | 64GB | Qwen3.5-27B/35B |

| Mac | M1/M2/M3 | 统一内存 | 16GB+ | 各种 7B-14B 模型 |

我的配置: RTX 3060 12GB + 32GB 内存,跑 Qwen3.5-9B 够用,选它的理由是中文能力好,日常对话、基础指令、写作辅助都还不错,可以做小龙虾的基础模型使用。

三、Ollama 安装步骤

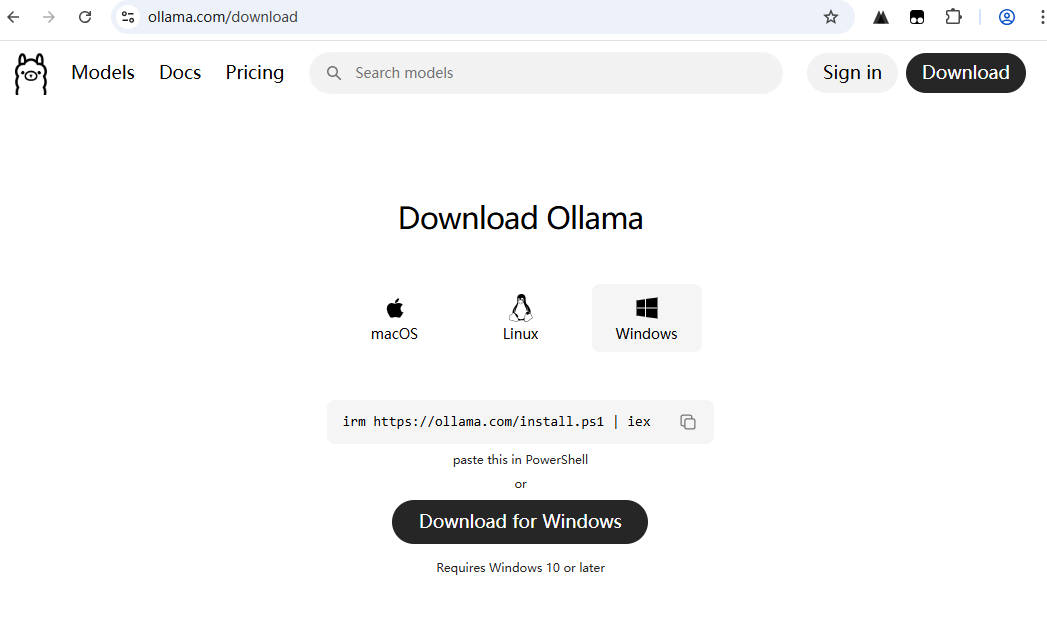

进入官网https://ollama.com/download

Linux (Ubuntu/Debian)

# 一键安装

curl -fsSL https://ollama.com/install.sh | sh

# 验证安装

ollama --version

# 启动服务(后台运行)

ollama serve

# 设置开机自启

sudo systemctl enable ollama

sudo systemctl start ollama

macOS

# 一键安装

curl -fsSL https://ollama.com/install.sh | sh

# 或者下载官方 App

# https://ollama.com/download/mac

Windows

# 一键安装

irm https://ollama.com/install.ps1 | iex

# 或者下载官方 App

# https://ollama.com/download/windows

```### 拉取模型

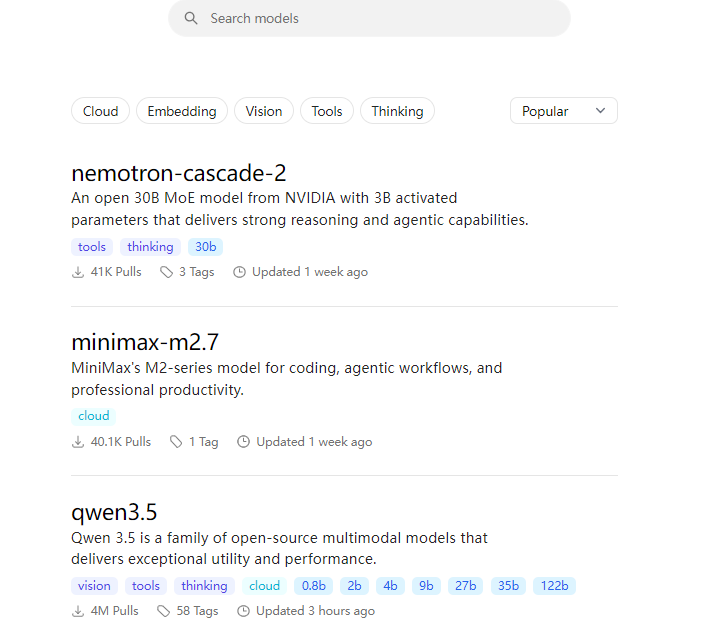

可以去官网`https://ollama.com/search`查看可用的模型,这里以**Qwen3.5-9B**为例

```bash

# 下载 Qwen3.5-9B

ollama pull qwen3.5:9b

# 查看已下载模型

ollama list

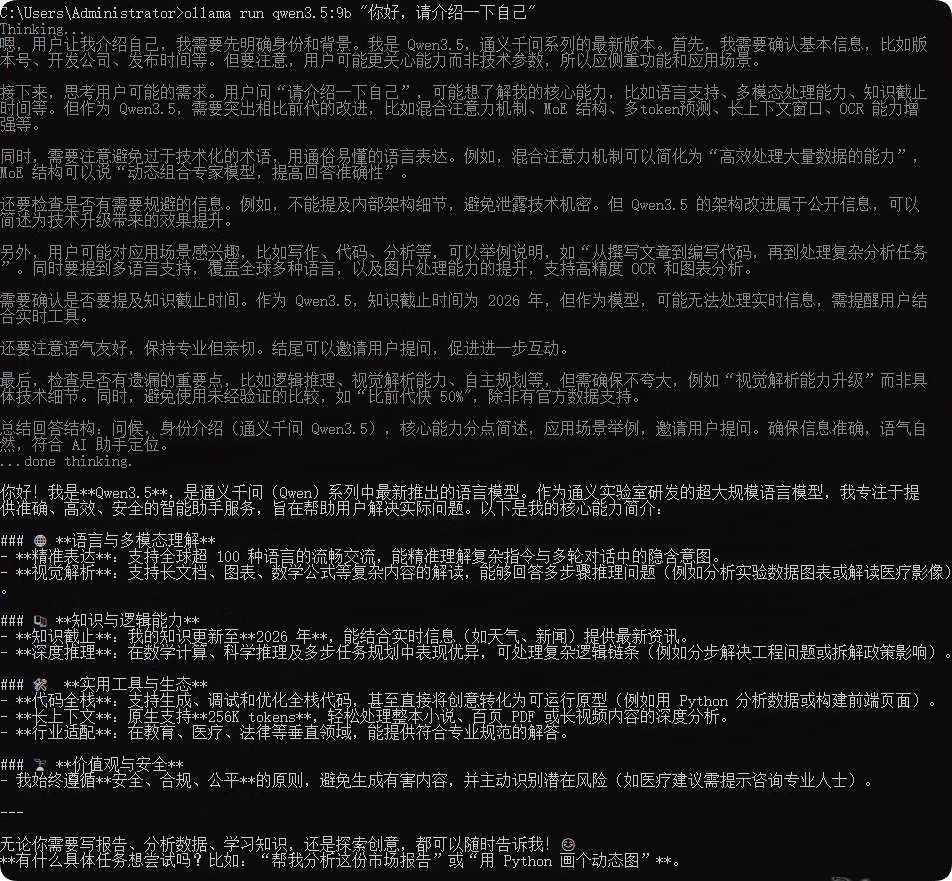

测试运行

# 交互式对话

ollama run qwen3.5:9b

# 单次问答

ollama run qwen3.5:9b "你好,请介绍一下自己"

# 查看服务状态

curl http://localhost:11434/api/tags

四、OpenClaw 配置 Ollama

修改配置

编辑 ~/.openclaw/config.json

{

"providers": {

"ollama": {

"baseUrl": "http://192.168.1.5:11434/v1", #我这小龙虾和ollama不在同一设备上

"apiKey": "", # 没有密钥,留空

"api": "openai-completions",

"models": [

{

"id": "qwen3.5:9b",

"name": "Qwen 3.5 9B",

"contextWindow": 524288,

"maxTokens": 262144 # qwen3.5 9b最大支持256Ktoken

}

]

},

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "这里是百炼CodingPlan的Key",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5 plus",

"contextWindow": 2097152,

"maxTokens": 1048576

}

]

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama/qwen3.5:9b",

"fallbacks": [

"bailian/qwen3.5-plus" # 备用百炼模型

]

}

}

}

}

测试

我是配置到New-API中转使用的,切换到qwen3.5:9b模型,输入文本测试。在Ollama中测试,感觉输出挺快的,但是放到OpenClaw中就发了一个“你好,测试一下模型”,结果输入Token 36k+,输出卡到怀疑人生(以上本人测试,数据仅提参考)

分析优化

可以看出显存炸了,内存飙升(应该用了共享GPU内存)。从网上资料来看,对于 Qwen3.5-9B 这样的模型,每 1k 输入 Token 大约会消耗 200-300MB 的显存用于 KV Cache,36k tokens 约占 7~10GB 显存,加上基础模型占用6G左右,已经超过12G显存了。

解决办法:

-

- 换成4B模型,这个基本不卡,输出几秒时间,“智商”有点弱,日常对话简单任务还行,偶尔会“犯傻”。

-

- 修改裁剪大小,把输入Token限制在10k以内,但是加点技能历史记录什么的分分钟超这个值,对话裁剪都很难裁掉。

五、结论

没有好硬件还是不要给OpenClaw用本地模型,qwen3.5 4b有点弱,给OpenClaw基础日常用9b是基础,显卡得3090/4090才流畅。听说微软最近推出了BitNet以1.58-bit三值量化技术,可以降低显卡要求,有空了折腾一下怎么玩。

评论区